关注我们的 WhatsApp 频道, TikTok 与 Instagram 以观看最新的短视频 - 开箱,测评与第一手新闻资讯。

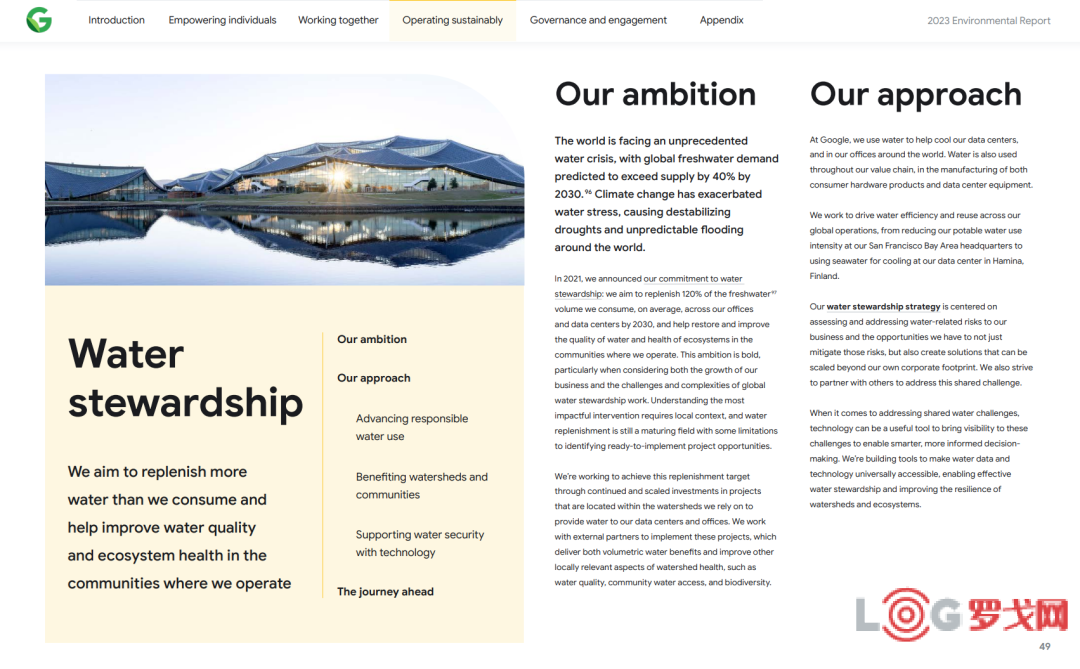

随着生成式AI的迅猛发展,巨大的数据中心成为支撑其运行的不可或缺的基础。然而,数据中心的耗电和大量冷却需求,让AI成为“耗水大户”!

最近,Google发布的2023年环境报告揭示,去年该公司的用水量较前年增长20%,高达56亿gal,其中绝大部分用于数据中心的冷却散热。这个数字相当惊人,大致相当于全球每天饮用水量的四分之一。

然而,Google并非个例。2023年初,OpenAI推出的ChatGPT一度风靡全球。其大规模训练AI模型不仅需要庞大算力,也要相应的散热能力。据称,仅与ChatGPT进行20个至50个问题的对话,就相当于消耗了一瓶500ml的水。考虑到ChatGPT在全球拥有数十亿用户,其累积的用水量令人震惊。

Microsoft在训练GPT-3时,估计消耗了700,000L水。如果AI模型的数据由低效能源数据中心生成,水的用量可能会增加三倍。对于OpenAI新推出的GPT-4,水的用量可能会是GPT-3的数倍。

另外的研究表明,GPT-3聊天模型的创建,消耗了1,287MWh的电力,并排放了552t二氧化碳。

专家们指出,尽管人工智能为人们带来了便利,但也应当尽量减少其使用,因为其背后可能会对环境产生严重影响。

更多科技资讯,请继续守住 TechNave 中文版!

【资料来源】

大家来评论